FLUX.1 Dev

FLUX.1 Dev est un modèle IA texte-vers-image avancé, à poids ouverts et distillé par guidage, développé par Black Forest Labs, offrant une génération d’images d...

Modèle d'IA

Stable Diffusion 3.5 Medium est un puissant modèle d’IA conçu pour générer des images de haute qualité avec un style unique.

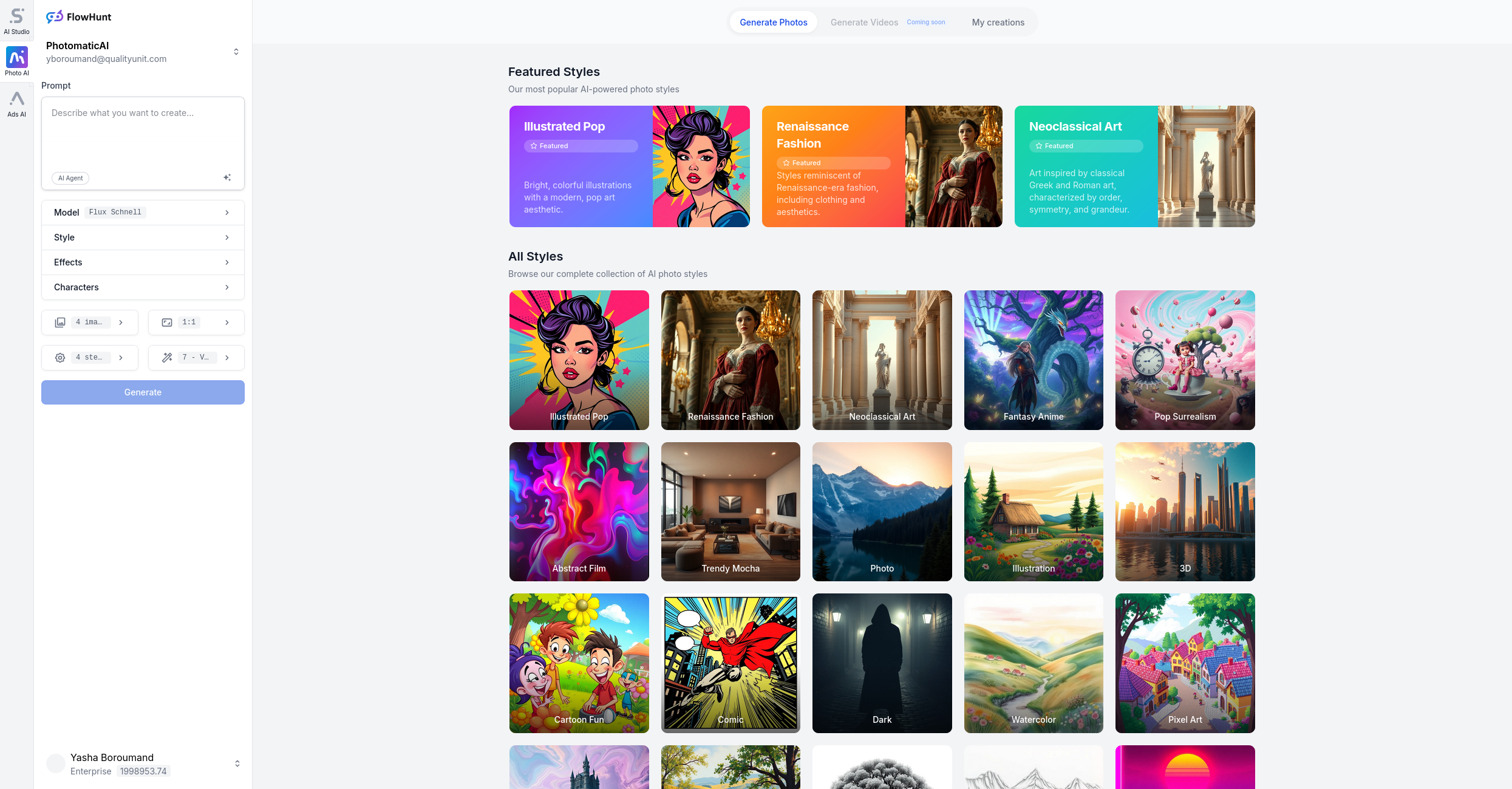

Nous regroupons les meilleurs modèles d'IA pour vous aider à générer des images avec des effets et des styles personnalisés.

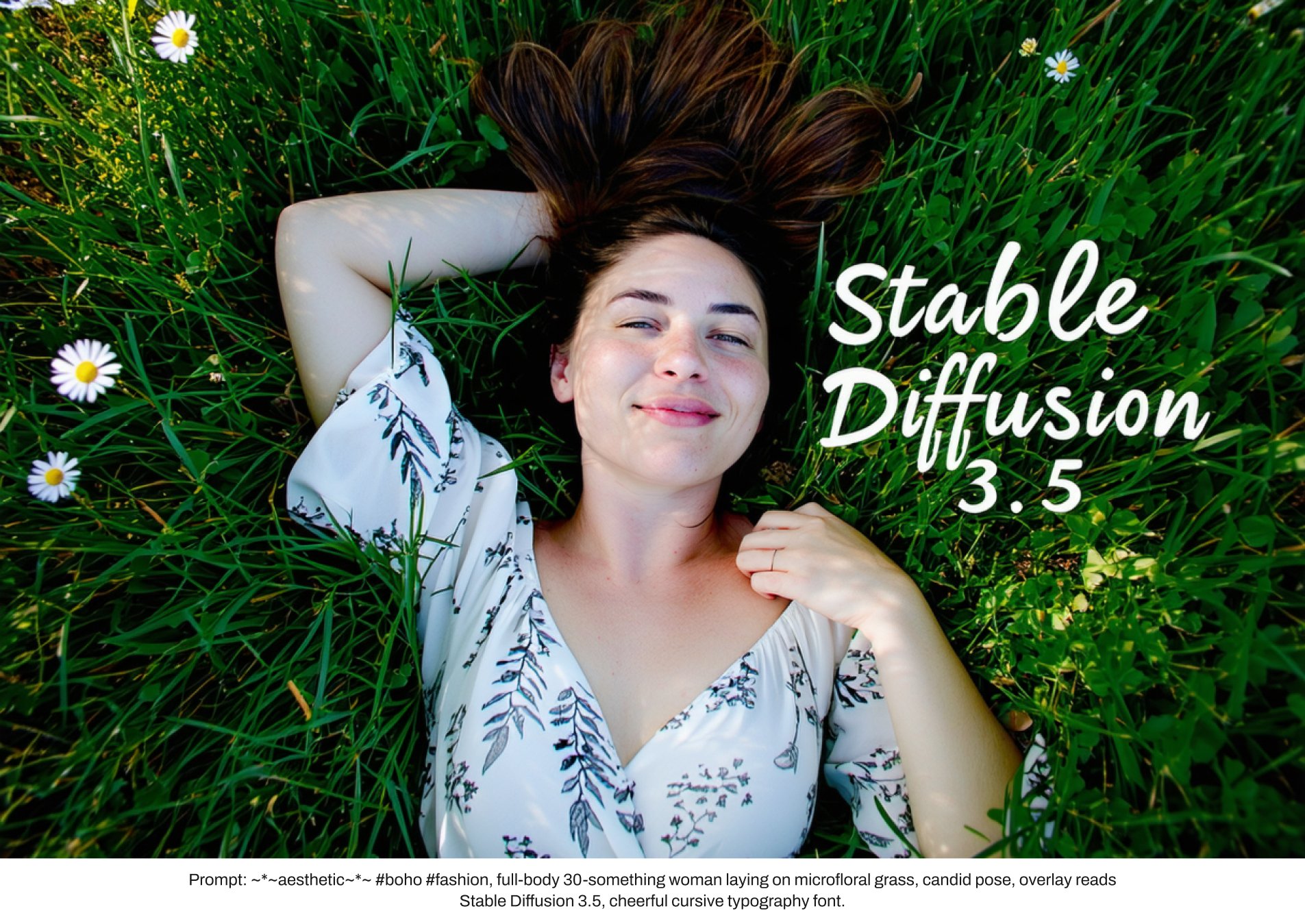

Générez des images IA avec les derniers modèles d'IA%!(EXTRA string=Stable Diffusion 3.5 Medium)

Stable Diffusion 3.5 Medium, publié par Stability AI en octobre 2024, représente une avancée majeure dans la synthèse texte-image et constitue la prochaine étape de la très populaire série Stable Diffusion. Ce modèle est spécialement conçu pour offrir un équilibre entre rapidité de génération, polyvalence et haute qualité d’image, ce qui le rend adapté à une large gamme d’usages créatifs et commerciaux.

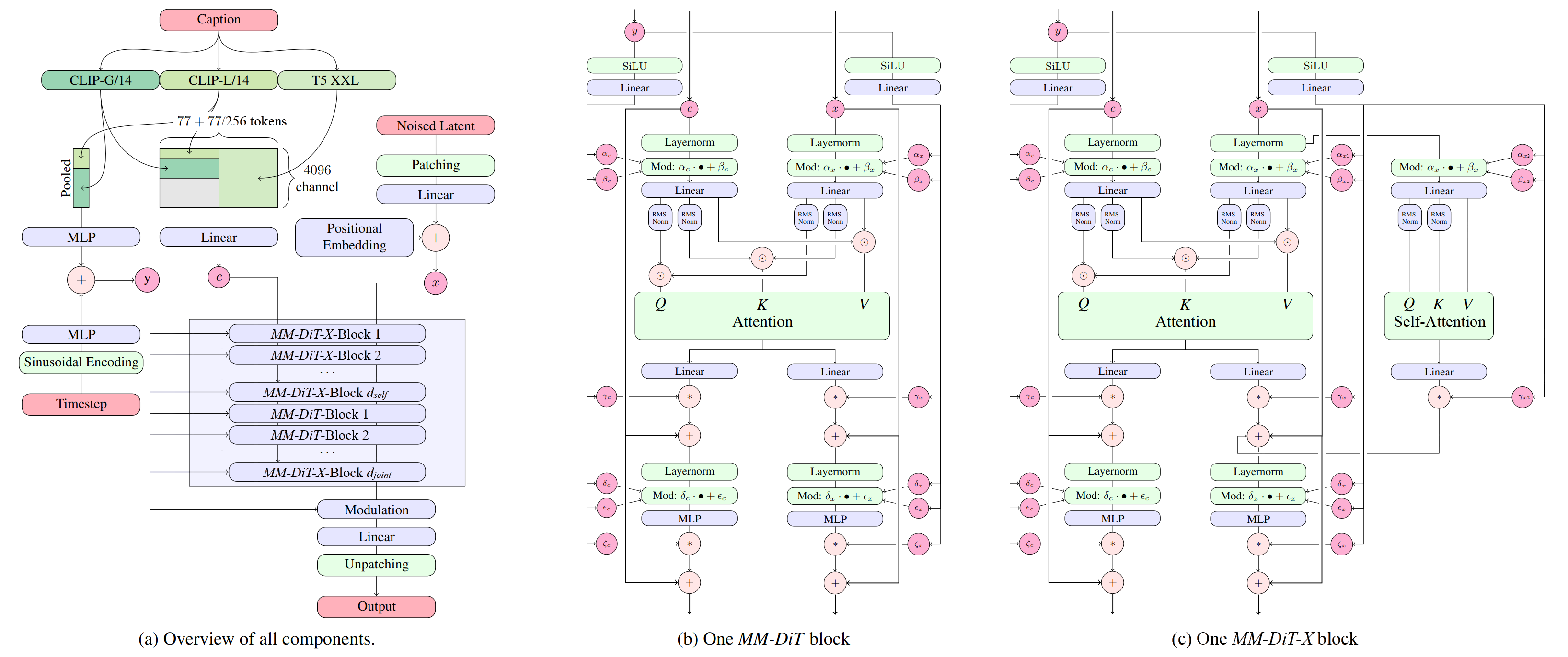

Au cœur du modèle, Stable Diffusion 3.5 Medium repose sur l’architecture améliorée MMDiT-X (Multimodal Diffusion Transformer-X). Ce modèle comporte environ 2,5 milliards de paramètres, offrant un équilibre optimal entre efficacité de calcul et puissance d’expression.

Les principales améliorations techniques incluent :

| Fonctionnalité | SD 3.0 Medium | SD 3.5 Medium | Amélioration |

|---|---|---|---|

| Paramètres | ~1,2B | 2,5B | Fidélité supérieure |

| Architecture principale | MMDiT | MMDiT-X | Gestion nuancée des requêtes |

| Qualité d’image | Bonne | Excellente | Plus nette, plus détaillée |

| Filtrage négatif | Basique | Avancé | Sortie plus fiable |

| Vitesse | Rapide | Rapide | Maintenue |

Ce qui est mieux dans la version 3.5 Medium :

Stable Diffusion 3.5 Medium rivalise, et souvent surpasse, d’autres modèles texte-image open source ou propriétaires dans plusieurs domaines clés :

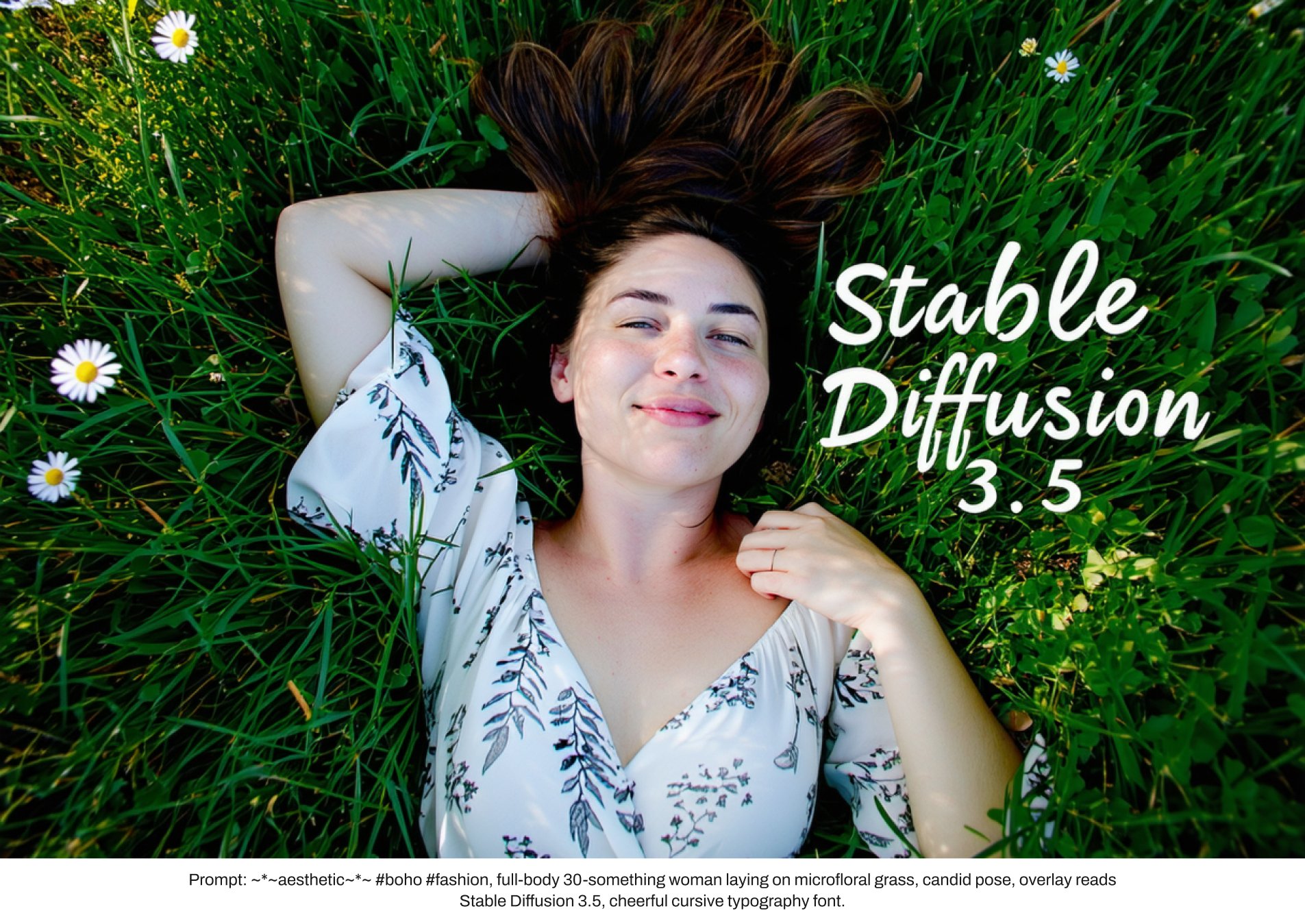

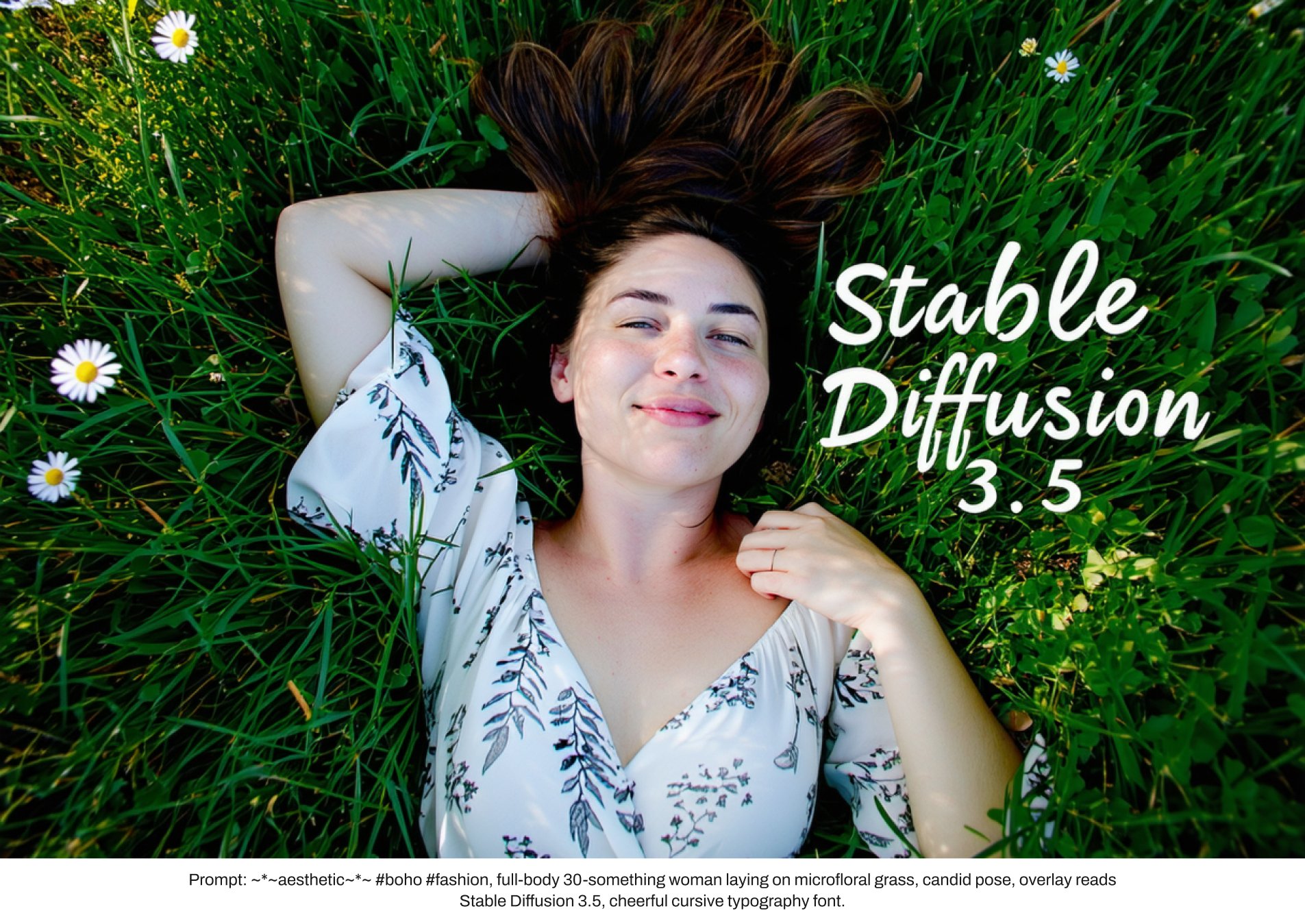

Voici des exemples d’images générées par Stable Diffusion 3.5 Medium, illustrant sa capacité à interpréter des requêtes complexes avec une grande précision et un style artistique marqué.

Stable Diffusion 3.5 Medium est un modèle d’IA de pointe pour la génération d’images à partir de texte, repoussant les limites de l’IA générative en accès ouvert. En combinant une architecture avancée, un entraînement robuste et un développement communautaire, il établit de nouveaux standards en matière de qualité d’image, de contrôle et d’efficacité.

Pour plus de détails et d’exemples d’images, consultez la page officielle de lancement de Stability AI et la fiche du modèle sur Hugging Face .

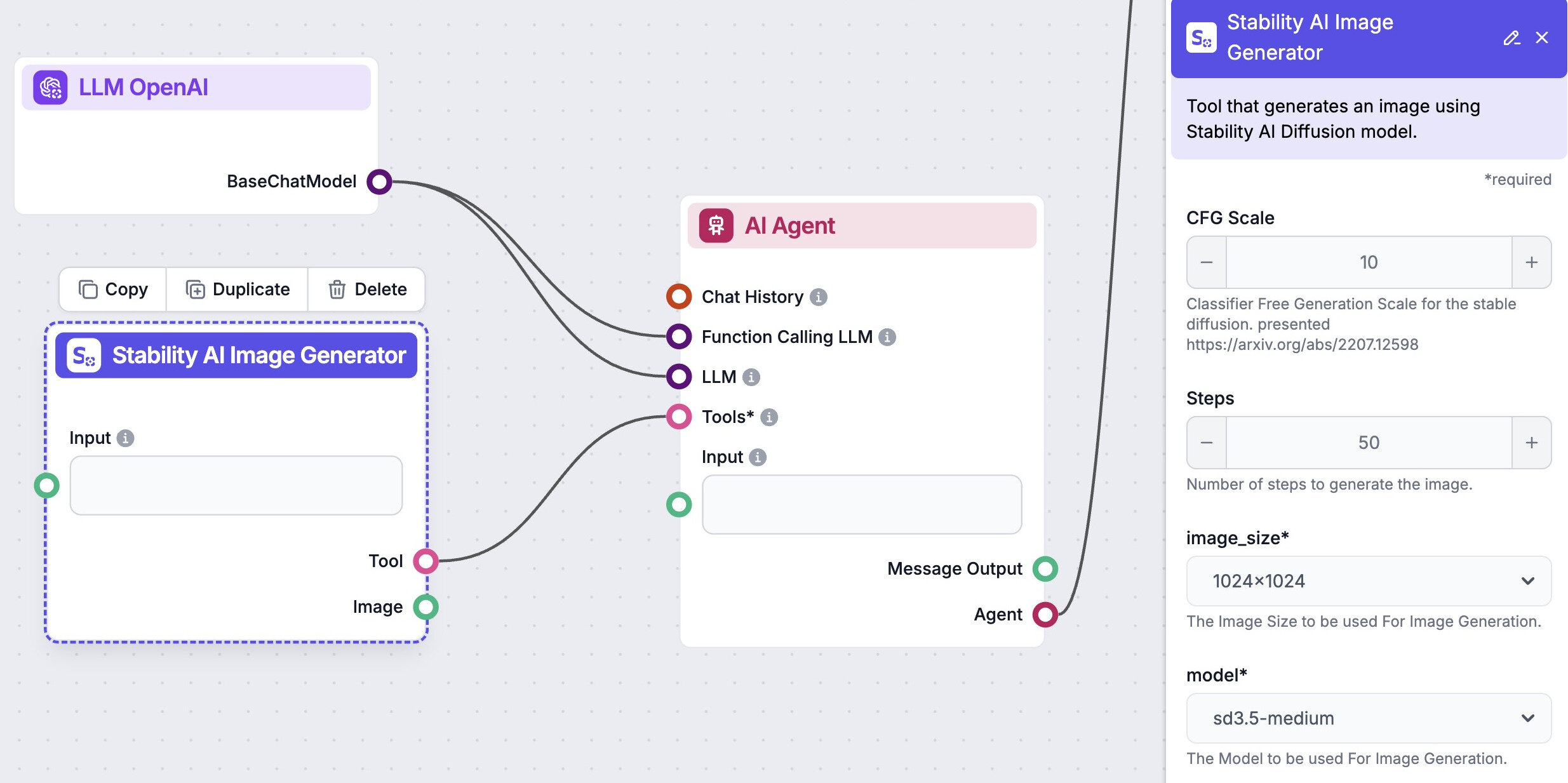

Automatisez votre génération d'images avec les Agents IA

FlowHunt est bien plus qu’une plateforme de génération d’images. Vous pouvez automatiser votre processus de génération d’images avec des Agents IA ou des Équipes dans AI Studio. Créez des visuels impressionnants en quelques secondes, adaptés à vos besoins. Que vous ayez besoin de photos de produits, de visuels marketing ou d’œuvres d’art uniques, notre plateforme vous permet de donner vie à vos idées facilement. AI Studio prend en charge une large gamme de modèles de génération d’images.

Exemples d’utilisation :

Remarque : Toutes les images de cette page ont été générées automatiquement par un agent IA et un flux de travail automatisé.

Laissez-nous vous aider à automatiser vos tâches de marketing. Notre plateforme vous permet de créer des chatbots IA, des agents et des flux de travail personnalisés qui peuvent gérer une large gamme de tâches, du support client à la génération de contenu.

Générez des visuels marketing professionnels en quelques secondes. Notre IA crée des images impressionnantes qui maintiennent la cohérence de votre marque à travers toutes vos campagnes sans services de design coûteux.

Produisez efficacement de grands volumes de contenu personnalisé. Créez des centaines d'images, d'articles de blog et de matériels marketing simultanément avec nos flux de travail d'automatisation IA.

Entraînez des modèles d'IA sur les éléments de votre marque pour créer des visuels uniques et fidèles à votre marque pour n'importe quelle campagne. Maintenez une identité visuelle cohérente sur tous les canaux marketing avec la technologie d'entraînement de personnages.

Explorez d'autres modèles d'IA que vous pouvez utiliser pour générer des images sur notre plateforme

FLUX.1 Dev est un modèle IA texte-vers-image avancé, à poids ouverts et distillé par guidage, développé par Black Forest Labs, offrant une génération d’images d...

FLUX.1 Schnell est un modèle d’IA texte-vers-image ultrarapide et de pointe, développé par Black Forest Labs, pour une génération d’images rapide et de haute qu...

Ideogram V3 Équilibré est un modèle d'IA avancé pour la génération d’images à partir de texte, optimisé pour offrir un équilibre remarquable entre rapidité, qua...

Ideogram V3 Turbo est un modèle IA de conversion texte-image de pointe, excellent en photoréalisme, design créatif et rendu avancé de texte, avec des fonctionna...

Qualité Ideogram V3 est un modèle d'IA texte-vers-image de premier plan qui offre un réalisme époustouflant, des designs créatifs et des styles cohérents, établ...

Ideogram V2 est un modèle d'IA texte-vers-image avancé offrant un réalisme de pointe, des capacités de design graphique et un rendu de texte inégalé. Il propose...

Ideogram V2 Turbo est un modèle d'IA de pointe conçu pour une génération texte-vers-image rapide et de haute qualité, excellant dans la compréhension des prompt...

Ideogram V2A est un modèle d'IA texte-vers-image avancé et efficace, offrant une génération plus rapide et économique avec des options polyvalentes de styles et...

Ideogram V2A Turbo est un modèle d’IA texte-vers-image avancé axé sur une génération d’images ultra-rapide, une qualité de sortie élevée et des capacités robust...

Imagen 3 est le modèle d’IA de génération d’images à partir de texte le plus avancé de Google, offrant une génération d’images photoréalistes, très détaillées e...

Stable Diffusion 3.5 Large est le modèle d'IA texte-image le plus avancé de Stability AI, offrant une qualité d'image supérieure, une meilleure fidélité aux pro...

Stable Diffusion 3.5 Large Turbo est un modèle d'IA de pointe pour la génération d'images à partir de texte, conçu pour une synthèse d'images ultra-rapide et de...